Работы не смогут захватить мир: люди оказались хитрее

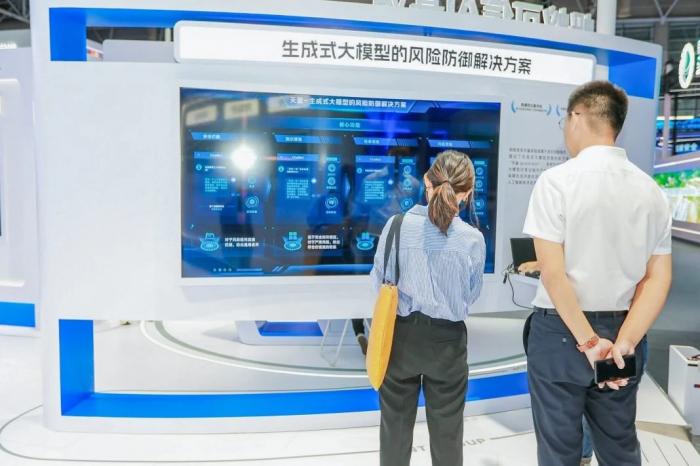

Ant Group запустила AntGuard — значительный шаг в решении проблем безопасности, связанных с большими моделями искусственного интеллекта. Это решение состоит из двух основных частей: «AntScan 2.0» и «TianGuard», целью которых является повышение надежности и достоверности крупных моделей искусственного интеллекта, используемых в различных отраслях.

Основная цель AntGuard — решение проблем безопасности, связанных с проблемными обучающими данными, неконтролируемыми процессами вывода и внешним вредоносным воздействием. Основное внимание уделяется трем основным направлениям: измерению безопасности больших моделей, интеллектуальному управлению рисками и решению проблем с данными.

AntScan 2.0 выступает в качестве эксперта по безопасности для больших моделей. Прежде чем эти модели будут запущены в производство, они тщательно тестируются, выявляя уязвимости в различных аспектах, таких как безопасность данных, безопасность контента и моральные соображения.

TianGuard, с другой стороны, действует как защитный щит для более крупных моделей. Он использует интеллектуальную технологию контроля рисков для защиты моделей от вредоносных внешних запросов и фильтрации потенциально опасных ответов, генерируемых этими моделями. Такой подход обеспечивает безопасность на протяжении всего процесса, от пользовательского ввода до исходных данных модели после развертывания.

Кроме того, Ant Group и TianGuard стремятся поддерживать безопасность моделей как на этапе обучения, так и на этапе использования. Они достигают этого путем реализации таких стратегий, как очистка проблемных источников данных, согласование процессов обучения и проведение исследований для повышения прозрачности модели.

Источник: Гизмочина